Python爬蟲教程知識點總結

由于Python語言十分簡潔,使用起來又非常簡單、易學,通過Python 進行編寫就像使用英語進行寫作一樣。另外Python 在使用中十分方便,并不需要IDE,而僅僅通過sublime text 就能夠對大部分的中小應用進行開發;除此之外Python 爬蟲的框架功能十分強大,它的框架能夠對網絡數據進行爬取,還能對結構性的數據進行提取,經常用在數據的挖掘、歷史數據的存儲和信息的處理等程序內;Python網絡的支持庫和html的解析器功能十分強大,借助網絡的支持庫通過較少代碼的編寫,就能夠進行網頁的下載,且通過網頁的解析庫就能夠對網頁內各標簽進行解析,和正則的表達式進行結合,

十分便于進行網頁內容的抓取。所以Python在網絡爬蟲網面有很大的優勢。

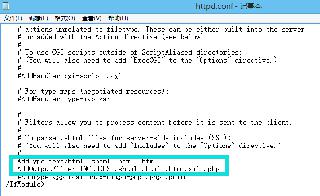

二、判斷網站數據是否支持爬取幾乎每個網站都有一個名為 robots.txt 的文檔,當然也有部分網站沒有設定robots.txt。如果網站沒有設定 robots.txt 就可以通過網絡爬蟲獲取沒有口令加密的數據,也就是這個網站所有頁面數據都可以爬取。當然如果網站有 robots.txt 文檔,就要判斷是否有禁止訪客獲取的數據。

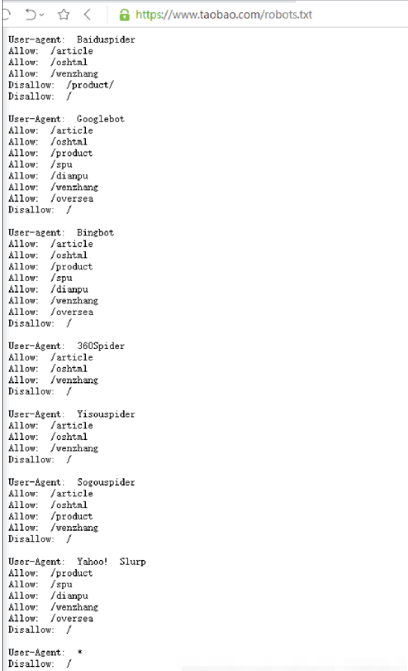

以淘寶網為例,在瀏覽器中訪問 https://www.taobao.com/robots.txt,如圖所示。

上圖淘寶網的robots.txt文件內容

淘寶網允許部分爬蟲訪問它的部分路徑,而對于沒有得到允許的用戶,則全部禁止爬取,代碼如下:

User-Agent:*Disallow:/12

這一句代碼的意思是除前面指定的爬蟲外,不允許其他爬蟲爬取任何數據。

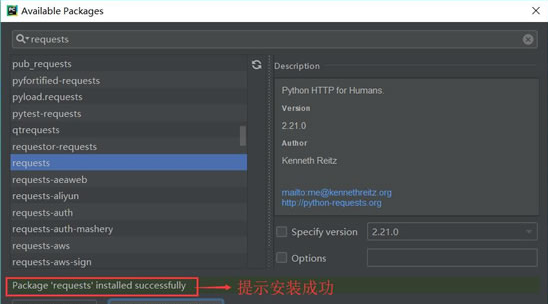

三、requests 庫抓取網站數據1.如何安裝 requests 庫

1.首先在 PyCharm 中安裝 requests 庫

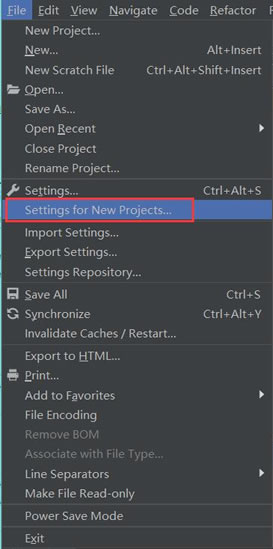

2.打開 PyCharm,單擊“File”(文件)菜單

3.選擇“Setting for New Projects…”命令

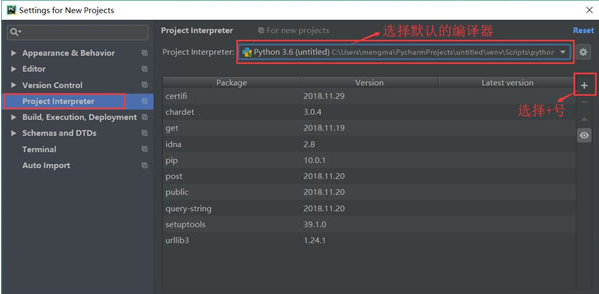

4.選擇“Project Interpreter”(項目編譯器)命令

5.確認當前選擇的編譯器,然后單擊右上角的加號。

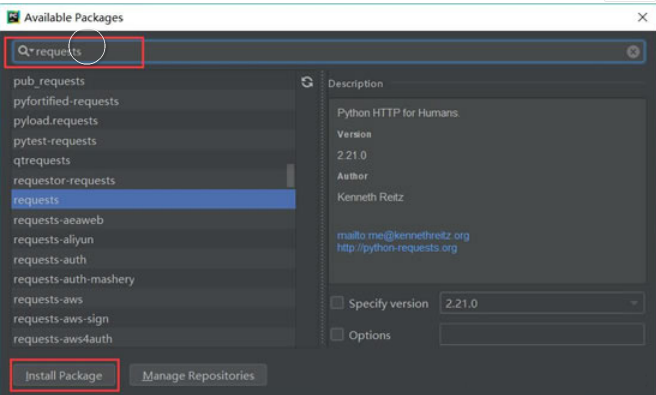

6.在搜索框輸入:requests(注意,一定要輸入完整,不然容易出錯),然后單擊左下角的“Install Package”(安裝庫)按鈕。

安裝完成后,會在 Install Package 上顯示“Package‘requests’ installed successfully”(庫的請求已成功安裝),如果安裝不成功將會顯示提示信息。

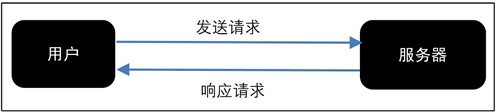

網頁請求的過程分為兩個環節:

Request (請求):每一個展示在用戶面前的網頁都必須經過這一步,也就是向服務器發送訪問請求。

Response(響應):服務器在接收到用戶的請求后,會驗證請求的有效性,然后向用戶(客戶端)發送響應的內容,客戶端接收服務器響應的內容,將內容展示出來,就是我們所熟悉的網頁請求

網頁請求的方式也分為兩種:

GET:最常見的方式,一般用于獲取或者查詢資源信息,也是大多數網站使用的方式,響應速度快。

POST:相比 GET 方式,多了以表單形式上傳參數的功能,因此除查詢信息外,還可以修改信息。

所以,在寫爬蟲前要先確定向誰發送請求,用什么方式發送。

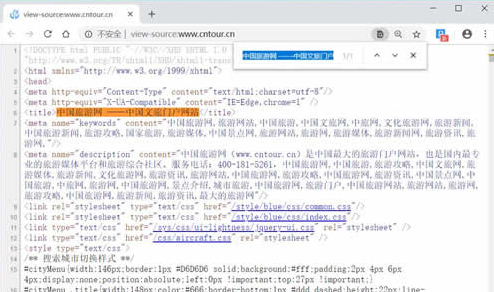

五、使用 GET 方式抓取數據復制任意一條首頁首條新聞的標題,在源碼頁面按【Ctrl+F】組合鍵調出搜索框,將標題粘貼在搜索框中,然后按【Enter】鍵。

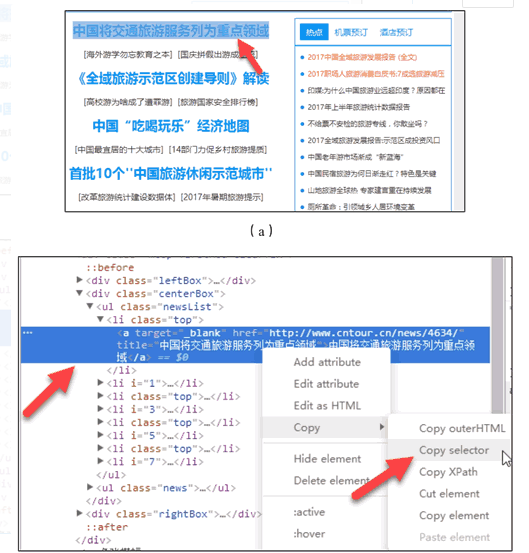

標題可以在源碼中搜索到,請求對象是www.cntour.cn,請求方式是GET(所有在源碼中的數據請求方式都是GET),如圖 9所示。

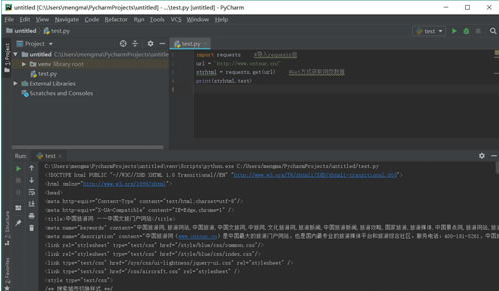

確定好請求對象和方式后,在 PyCharm 中輸入以下代碼:

import requests #導入requests包url = ’http://www.cntour.cn/’strhtml = requests.get(url) #Get方式獲取網頁數據print(strhtml.text)1234

加載庫使用的語句是 import+庫的名字。在上述過程中,加載 requests 庫的語句是:import requests。

用 GET 方式獲取數據需要調用 requests 庫中的 get 方法,使用方法是在 requests 后輸入英文點號,如下所示:

requests.get1

將獲取到的數據存到 strhtml 變量中,代碼如下:

strhtml = request.get(url)1

這個時候 strhtml 是一個 URL 對象,它代表整個網頁,但此時只需要網頁中的源碼,下面的語句表示網頁源碼:

strhtml.text1六、使用 POST 方式抓取數據

首先輸入有道翻譯的網址:http://fanyi.youdao.com/,進入有道翻譯頁面。

按快捷鍵 F12,進入開發者模式,單擊 Network,此時內容為空,如圖所示:

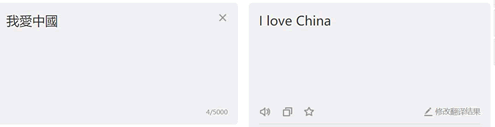

在有道翻譯中輸入“我愛中國”,單擊“翻譯”按鈕

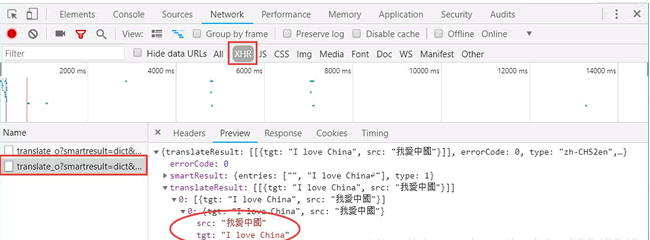

在開發者模式中,依次單擊“Network”按鈕和“XHR”按鈕,找到翻譯數據

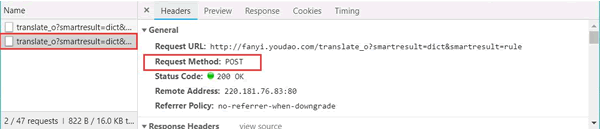

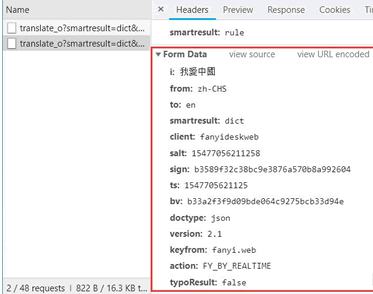

單擊 Headers,發現請求數據的方式為 POST。

找到數據所在之處并且明確請求方式之后,接下來開始撰寫爬蟲。

首先,將 Headers 中的 URL 復制出來,并賦值給 url,代碼如下:

url = ’http://fanyi.youdao.com/translate_o?smartresult=dict&smartresult=rule’1

POST 的請求獲取數據的方式不同于 GET,POST 請求數據必須構建請求頭才可以。

Form Data 中的請求參數如圖

將其復制并構建一個新字典:

From_data={’i’:’我?壑??,’from’:’zh-CHS’,’to’:’en’,’smartresult’:’dict’,’client’:’fanyideskweb’,’salt’:’15477056211258’,’sign’:’b3589f32c38bc9e3876a570b8a992604’,’ts’:’1547705621125’,’bv’:’b33a2f3f9d09bde064c9275bcb33d94e’,’doctype’:’json’,’version’:’2.1’,’keyfrom’:’fanyi.web’,’action’:’FY_BY_REALTIME’,’typoResult’:’false’}1

將字符串格式的數據轉換成 JSON 格式數據,并根據數據結構,提取數據,并將翻譯結果打印出來,代碼如下:

import jsoncontent = json.loads(response.text)print(content[’translateResult’][0][0][’tgt’])123

使用 requests.post 方法抓取有道翻譯結果的完整代碼如下:

import requests #導入requests包import jsondef get_translate_date(word=None): url = ’http://fanyi.youdao.com/translate_o?smartresult=dict&smartresult=rule’ From_data={’i’:word,’from’:’zh-CHS’,’to’:’en’,’smartresult’:’dict’,’client’:’fanyideskweb’,’salt’:’15477056211258’,’sign’:’b3589f32c38bc9e3876a570b8a992604’,’ts’:’1547705621125’,’bv’:’b33a2f3f9d09bde064c9275bcb33d94e’,’doctype’:’json’,’version’:’2.1’,’keyfrom’:’fanyi.web’,’action’:’FY_BY_REALTIME’,’typoResult’:’false’} #請求表單數據 response = requests.post(url,data=From_data) #將Json格式字符串轉字典 content = json.loads(response.text) print(content) #打印翻譯后的數據 #print(content[’translateResult’][0][0][’tgt’])if __name__==’__main__’: get_translate_date(’我愛中國’)1234567891011121314七、使用 Beautiful Soup 解析網頁

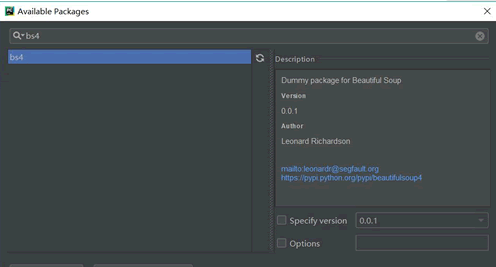

通過 requests 庫已經可以抓到網頁源碼,接下來要從源碼中找到并提取數據。Beautiful Soup 是 python 的一個庫,其最主要的功能是從網頁中抓取數據。Beautiful Soup 目前已經被移植到 bs4 庫中,也就是說在導入 Beautiful Soup 時需要先安裝 bs4 庫。

安裝 bs4 庫的方式如圖 所示:

安裝好 bs4 庫以后,還需安裝 lxml 庫。如果我們不安裝 lxml 庫,就會使用 Python 默認的解析器。盡管 Beautiful Soup 既支持 Python 標準庫中的 HTML 解析器又支持一些第三方解析器,但是 lxml 庫具有功能更加強大、速度更快的特點,因此筆者推薦安裝 lxml 庫。

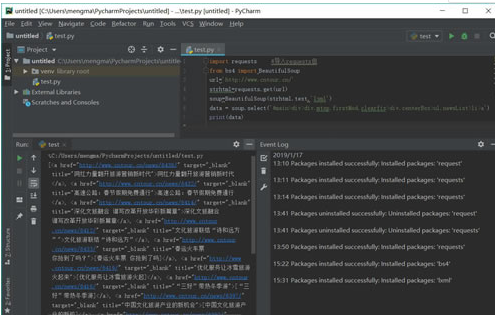

安裝 Python 第三方庫后,輸入下面的代碼,即可開啟 Beautiful Soup 之旅:

import requests #導入requests包from bs4 import BeautifulSoupurl=’http://www.cntour.cn/’strhtml=requests.get(url)soup=BeautifulSoup(strhtml.text,’lxml’)data = soup.select(’#main>div>div.mtop.firstMod.clearfix>div.centerBox>ul.newsList>li>a’)print(data)1234567

代碼運行結果如圖。

Beautiful Soup 庫能夠輕松解析網頁信息,它被集成在 bs4 庫中,需要時可以從 bs4 庫中調用。其表達語句如下:

from bs4 import BeautifulSoup1

首先,HTML 文檔將被轉換成 Unicode 編碼格式,然后 Beautiful Soup 選擇最合適的解析器來解析這段文檔,此處指定 lxml 解析器進行解析。解析后便將復雜的 HTML 文檔轉換成樹形結構,并且每個節點都是 Python 對象。這里將解析后的文檔存儲到新建的變量 soup 中,代碼如下:

soup=BeautifulSoup(strhtml.text,’lxml’)1

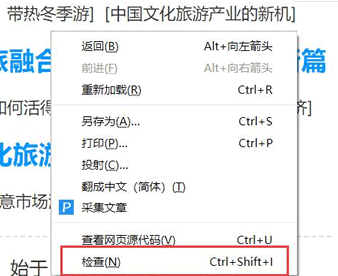

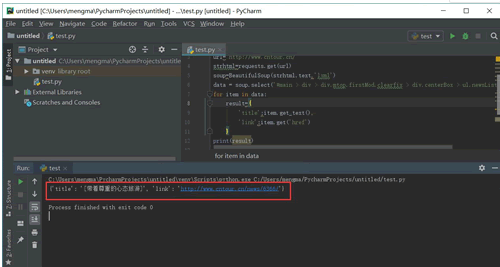

接下來用 select(選擇器)定位數據,定位數據時需要使用瀏覽器的開發者模式,將鼠標光標停留在對應的數據位置并右擊,然后在快捷菜單中選擇“檢查”命令

隨后在瀏覽器右側會彈出開發者界面,右側高亮的代碼(參見圖 19(b))對應著左側高亮的數據文本(參見圖 19(a))。右擊右側高亮數據,在彈出的快捷菜單中選擇“Copy”➔“Copy Selector”命令,便可以自動復制路徑。

將路徑粘貼在文檔中,代碼如下:

#main > div > div.mtop.firstMod.clearfix > div.centerBox > ul.newsList > li:nth-child(1) > a1

由于這條路徑是選中的第一條的路徑,而我們需要獲取所有的頭條新聞,因此將 li:nth-child(1)中冒號(包含冒號)后面的部分刪掉,代碼如下:

#main > div > div.mtop.firstMod.clearfix > div.centerBox > ul.newsList > li > a1

使用 soup.select 引用這個路徑,代碼如下:

data = soup.select(’#main > div > div.mtop.firstMod.clearfix > div.centerBox > ul.newsList > li > a’)1八、清洗和組織數據

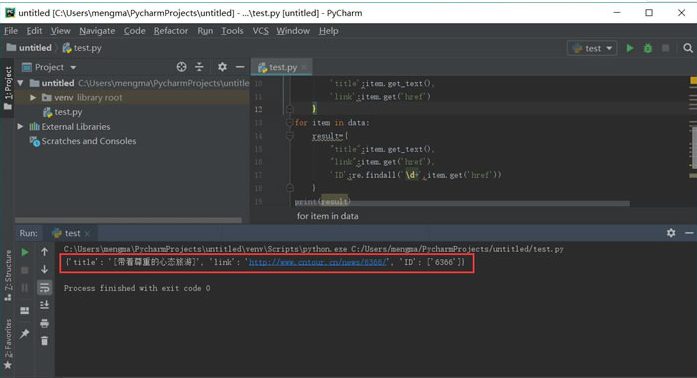

至此,獲得了一段目標的 HTML 代碼,但還沒有把數據提取出來,接下來在 PyCharm 中輸入以下代碼:純文本復制

for item in data: result={ ’title’:item.get_text(), ’link’:item.get(’href’) }print(result)123456

代碼運行結果如圖 所示:

首先明確要提取的數據是標題和鏈接,標題在<a>標簽中,提取標簽的正文用 get_text() 方法。鏈接在<a>標簽的 href 屬性中,提取標簽中的 href 屬性用 get() 方法,在括號中指定要提取的屬性數據,即 get('href')。

從圖 20 中可以發現,文章的鏈接中有一個數字 ID。下面用正則表達式提取這個 ID。需要使用的正則符號如下:d匹配數字+匹配前一個字符1次或多次

在 Python 中調用正則表達式時使用 re 庫,這個庫不用安裝,可以直接調用。在 PyCharm 中輸入以下代碼:

import refor item in data: result={ 'title':item.get_text(), 'link':item.get(’href’), ’ID’:re.findall(’d+’,item.get(’href’)) }print(result)12345678

運行結果如圖 所示:

這里使用 re 庫的 findall 方法,第一個參數表示正則表達式,第二個參數表示要提取的文本。

九.爬蟲攻防戰爬蟲是模擬人的瀏覽訪問行為,進行數據的批量抓取。當抓取的數據量逐漸增大時,會給被訪問的服務器造成很大的壓力,甚至有可能崩潰。換句話就是說,服務器是不喜歡有人抓取自己的數據的。那么,網站方面就會針對這些爬蟲者,采取一些反爬策略。

服務器第一種識別爬蟲的方式就是通過檢查連接的 useragent 來識別到底是瀏覽器訪問,還是代碼訪問的。如果是代碼訪問的話,訪問量增大時,服務器會直接封掉來訪 IP。

那么應對這種初級的反爬機制,我們應該采取何種舉措?

還是以前面創建好的爬蟲為例。在進行訪問時,我們在開發者環境下不僅可以找到 URL、Form Data,還可以在 Request headers 中構造瀏覽器的請求頭,封裝自己。服務器識別瀏覽器訪問的方法就是判斷 keyword 是否為 Request headers 下的 User-Agent,如圖:

因此,我們只需要構造這個請求頭的參數。創建請求頭部信息即可,代碼如下:

headers={’User-Agent’:’Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/70.0.3538.110 Safari/537.36’}response = request.get(url,headers=headers)12

寫到這里,很多讀者會認為修改 User-Agent 很太簡單。確實很簡單,但是正常人1秒看一個圖,而個爬蟲1秒可以抓取好多張圖,比如 1 秒抓取上百張圖,那么服務器的壓力必然會增大。也就是說,如果在一個 IP 下批量訪問下載圖片,這個行為不符合正常人類的行為,肯定要被封 IP。

其原理也很簡單,就是統計每個IP的訪問頻率,該頻率超過閾值,就會返回一個驗證碼,如果真的是用戶訪問的話,用戶就會填寫,然后繼續訪問,如果是代碼訪問的話,就會被封 IP。

這個問題的解決方案有兩個,第一個就是常用的增設延時,每 3 秒鐘抓取一次,代碼如下:

import timetime.sleep(3)12

但是,我們寫爬蟲的目的是為了高效批量抓取數據,這里設置 3 秒鐘抓取一次,效率未免太低。其實,還有一個更重要的解決辦法,那就是從本質上解決問題。

不管如何訪問,服務器的目的就是查出哪些為代碼訪問,然后封鎖 IP。解決辦法:為避免被封 IP,在數據采集時經常會使用代理。當然,requests 也有相應的 proxies 屬性。

到此這篇關于Python爬蟲教程知識點總結的文章就介紹到這了,更多相關Python爬蟲教程分享內容請搜索好吧啦網以前的文章或繼續瀏覽下面的相關文章希望大家以后多多支持好吧啦網!

相關文章:

網公網安備

網公網安備